안녕하세요.

아인시스아이엔씨 입니다.

오늘은 초대형 AI 시대를 위한 데이터센터의 새로운 기준으로 떠오르고 있는 '메모리 벽(Memory Wall)’ 현상을 해결하기 위해 등장한 혁신적인 솔루션, NVIDIA H200 Tensor Core GPU를 소개해 보겠습니다.

최근 생성형 AI와 대규모 언어 모델(LLM)이 비즈니스의 핵심으로 자리 잡으면서, 기업의 고민은 단순한 연산 속도를 넘어 '메모리 병목 해소'에 집중되고 있습니다.

모델 파라미터가 수천억 개를 넘어서며 발생하는 '메모리 벽(Memory Wall)' 현상은 AI 서비스의 응답 속도와 운영 효율을 저해하는 가장 큰 장애물입니다.

NVIDIA H200은 이러한 시장의 요구를 정확히 관통하는 제품입니다.

기존 H100의 강력한 연산력을 계승하면서도, 세계 최초로 HBM3e 메모리를 채택해 데이터센터의 성능 기준을 한 단계 격상시켰습니다.

이러한 ‘메모리 벽(Memory Wall)’ 현상을 해결하기 위해 등장한 혁신적인 솔루션, NVIDIA H200 Tensor Core GPU를 소개합니다.

1. NVIDIA H200이란 무엇인가?

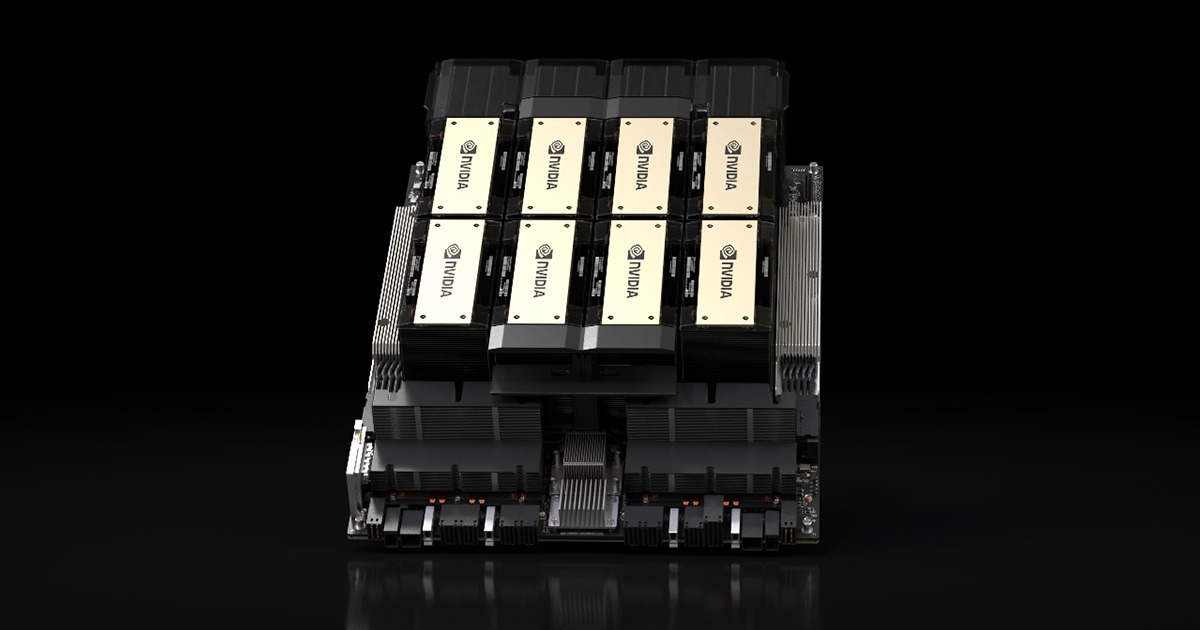

NVIDIA H200은 전 세계 데이터센터의 표준이었던 H100의 아키텍처를 계승하면서도, 메모리 성능을 극대화한 차세대 AI 가속 GPU입니다. 동일한 Hopper 아키텍처를 사용하지만, 세계 최초로 HBM3e 메모리를 탑재하여 현존하는 GPU 중 가장 강력한 데이터 처리 능력을 자랑합니다.

- 차세대 고대역폭 메모리 HBM3e 탑재: 기존 H100(80GB) 대비 약 76% 증가한 141GB의 초대용량 메모리를 제공합니다.

- 압도적인 메모리 대역폭: 초당 4.84TB의 데이터를 전송할 수 있어, H100 대비 약 1.4배 넓어진 대역폭은 메모리에서 처리 코어로 데이터를 보내는 통로를 시원하게 뚫어줍니다. 이는 데이터가 처리 코어를 기다리게 하는 'Data Stall' 현상을 방지합니다.

- 인프라 호환성: H100과 동일한 SXM 폼팩터를 유지하여, 기존 HGX H100 시스템 인프라를 그대로 활용하면서 GPU 교체만으로 즉각적인 성능 향상이 가능합니다.

NVIDIA H200 GPU

AI 및 HPC 워크로드를 강화합니다.

www.nvidia.com

2. H100 vs H200 무엇이 달라졌을까?

H200은 연산 성능의 구조적 변화보다는, 메모리 한계를 확장하여 실질적인 AI 서비스 성능(추론 및 학습 효율)을 끌어올린 모델입니다.

| 구분 | H100(SXM) | H200(SXM) |

| 아키텍처 | Hopper | Hopper |

| 메모리 | HBM3 80GB | HBM3e 141GB |

| 메모리 대역폭 | 3.35TB/s | 4.8TB/s |

| 주요활용도 | AI 학습 및 범용 가속 | 초대형 LLM 추론 및 고성능 학습 |

| 포지션 | 주력모델 | 상위/확장 모델 |

3. 왜 지금 H200이 필요한가?

단순히 "빠르다"는 것 이상의 비즈니스 가치가 H200에 담겨 있습니다.

초대형 모델의 단일 GPU 처리: 모델 파라미터가 너무 커서 H100 80GB 한 장에 담기지 않던 모델들도 H200에서는 단일 메모리에 로드되어 처리 효율이 극대화됩니다.

추론 성능의 비약적 향상: Llama2 70B와 같은 대형 모델에서 H100 대비 최대 2배 빠른 추론 속도를 보여줍니다. 이는 곧 고객 응답 속도 향상과 운영 비용(TCO) 절감을 의미합니다.

통신 병목 최소화: GPU 간 통신(NVLink) 의존도를 낮추고 개별 GPU의 처리량을 늘려 전체 클러스터의 효율성을 높입니다.

4. 도입 형태

NVIDIA H200은 일반 PC용 그래픽카드 형태가 아닌, 데이터센터 서버 탑재 전용 SXM 방식으로 공급됩니다.

HGX H200: 8개의 H200 GPU가 NVLink 및 NVSwitch로 연결된 고성능 서버 보드 형태로 제공됩니다.

Dell Technologies, HPE, Supermicro 등 글로벌 서버 제조사의 최신 AI 서버 제품군에 탑재되어 공급됩니다.

NVIDIA H200은 단순한 업그레이드 제품이 아닙니다. AI 모델의 크기와 복잡성이 기하급수적으로 증가하는 시장 흐름에 대응하기 위한 전략적 솔루션입니다.

- AI 모델 규모가 커져 기존 GPU의 메모리 한계를 겪고 계신 기업

- 대규모 서비스 환경에서 추론 처리량(Throughput)을 극대화하고 싶은 조직

- 장기적으로 총 소유 비용을 고려하여 고효율 AI 인프라를 구축하려는 기관

오늘은 NVIDIA H200 Tensor Core GPU에 대하여 알아보았습니다.

현재 아인시스 에서는 NVIDIA 최신 H200 솔루션을 포함하여, 대규모 AI 학습과 추론 환경에 맞게 구축해 드리고 구매또한 가능합니다.

견적관련 문의는 언제든 주시면 바로 답변드리겠습니다.

감사합니다.

https://www.einsis.com/ko/contact-us

(주)아인시스아이엔씨

토탈IT서비스 전문기업, 서버/네트워크 유통 및 솔루션 공급

www.einsis.com